La pregunta por el rol que desempeña la IA Generativa (IAG) en diversos procesos (y en especial los creativos) abre la posibilidad de diseñar y modelar esa relación, atendiendo a desafíos éticos que nos plantea el uso de estos modelos. En esta clase reformulamos la pregunta filosófica que analizamos semanas atrás para volver a pensar el tema desde la implementación y los usos situados de la IAG en las organizaciones y proyectos.

En esa oportunidad, planteábamos el concepto de affordances para pensar la capacidad de agencia del objeto en sí, y desde allí analizar los modos en que tal objeto sugiere, desde su mismo diseño, formas en las que puede ser usado. Del mismo modo que la arquitectura promueve ciertos usos del espacio. En nuestro caso el objeto son los modelos de lenguaje LLM que en su entrenamiento inicial y funcionamiento plantean desafíos de representación (linguísticos, culturales, de género, etc.) o riesgos extractivistas, entre tantos otros, a los que es preciso prestar atención y orientar desde guías prácticas. En adelante iremos puntualizando esos desafíos a partir de ejemplos concretos.

Dos señales de un contexto con nuevos actores

Veamos dos controversias recientes. A fines del 2025 Disney licenció 200 personajes en Sora, la plataforma de Open IA de creación de videos con IA, con el propósito de permitir que los usuarios utilicen estos personajes en sus videos (sin incluir la imagen ni la voz de ningún actor). Esta inversión se da en un contexto en el que las companías del sector audiovisual y discográficas han demandado a las plataformas de IA por el entrenamiento de sus modelos utilizando obras que están protegidas por copyright.

Por otro lado, Spotify se alía con las discográficas Sony, Universal y Warner, adquiriendo licencias de catálogos que incorpora a su herramienta DJ, para darle prioridad a los creadores y a la vez promover lo que la plataforma llama un uso responsable de IA. En el contexto de crecimiento del contenido automatizado, Spotify impulsa el etiquetado del contenido generado con IA, lo que podría permitir identificar aspectos tales como: qué modelo se utilizó en cada caso y cómo, y qué hicieron las personas; aspectos que refieren a la trazabilidad en el uso de IAG.

Los dos casos anteriores muestran una de las aristas de la problemática de la autoría con IA, que es el entrenamiento de los modelos basado en el procesamiento de contenido protegido por el derecho de autor. En este sentido es interesante analizar el proyecto de la librería de estilos de artistas renacentistas creada por Maria Laikova con la herramienta de imágenes Midjourney. En su sitio, la artista expresa que las imágenes no son representativas de los trabajos de los artistas reales, reconociendo el copyright o derecho de autor de tales obras, a la vez que menciona la finalidad educativa y de experimentación con la que crea el proyecto.

La trazabilidad de los procesos genera confianza

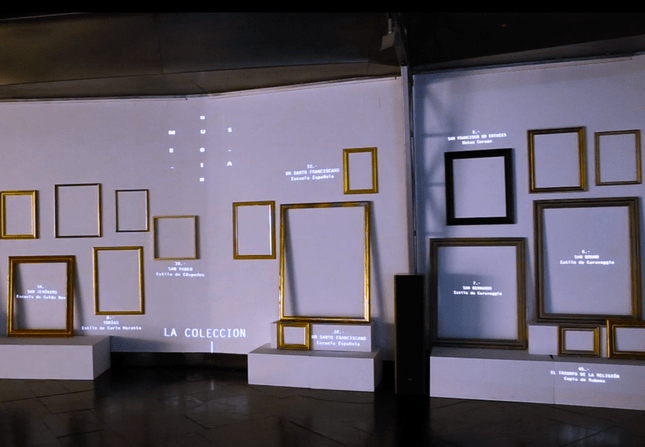

El ejemplo de Laikova muestra además la importancia que tiene la documentación de estos procesos, con el fin de generar transparencia y, en última instancia, confianza en el producto creado con IAG. Nos interesa también mencionar el caso de un proyecto curatorial que crea una colección de pinturas con IA para el Museo de Palencia, buscando reconstruir 57 imágenes desaparecidas a partir de las descripciones de catálogos históricos, y de 30.000 imágenes de grandes museos.

Lo llamativo de este caso es que la documentación del desarrollo, realizado entre 2019 y 2023, está atravedado por varias generaciones de algoritmos generativos y en especial por el pasaje de las redes generativas antagónicas (GAN) a los modelos de difusión, es decir, la utilización de diferentes técnicas.

La trazabilidad del desarrollo de sistemas requiere documentar todos los procesos: el propósito, el diseño, la arquitectura, los datos, el preprocesamiento, el entrenamiento, las pruebas y resultados; de modo que dichos procesos puedan ser supervisados y puedan reproducirse para llegar a los mismos resultados. Otro aspecto importante es que se requiere de la colaboración de expertos, que puedan monitorear los metadatos, es decir, aquellos datos que organizan y clasifican a los mismo datos.

La colección Biome Lumina, que se plantea como una enciclopedia de lo viviente, moldeada en base a millones de imágenes junto a grabaciones de sonidos y señales de biosensores, reúne en su desarrollo a científicos e investigadores de datos, para crear datasets curados en base a criterios éticos. Así lo explican:

Se entrena con un conjunto de datos cuidadosamente seleccionado de más de 2.6 millones de imágenes, que representan casi 10.000 especies únicas y están etiquetadas con nombres comunes y científicos. Este conjunto de datos, cuidadosamente seleccionado de nuestro archivo de 180 millones de imágenes, garantiza una precisión y un realismo excepcionales, lo que contribuye al liderazgo del LNM en IA centrada en la naturaleza.

En este marco cobra sentido definir protocolos o guías prácticas que permitan identificar situaciones de uso de IAG, y darle mayor trazabilidad y transparencia a los procesos y modos de autoría. Madoery (2025) puntualiza algunos protocolos posibles vinculados a situaciones tales como:

- convocatorias de trabajos o creación de contenidos: donde los protocolos pueden identificar si se utilizó o no IAG y qué usos se hicieron (incluyendo el prompt utilizado), de modo de no perder la trazabilidad y los modos de autoría;

- análisis de archivos y bases de datos, en los que es fundamental anonimizar los datos y revisar posibles sesgos antes de publicarlos;

- protección de la diversidad cultural, priorizando datasets situados y visibilizando culturas locales que están en riesgo de ser “borradas”.

Los animamos a que puedan proponer alguna guía práctica en el marco de sus proyectos transmedia, que contribuyan a crear colaboraciones más trasparentes, valiosas y justas.

Compartimos la presentación de la clase